电商数据分析之数据抓取技术:原理、实操与合规指南

在电商行业,数据是驱动业务决策、优化运营策略的核心资产——无论是监测商品销售动态、分析用户消费行为,还是调研竞品市场表现、预判行业趋势,都离不开大量精准、实时的数据支撑。但电商数据体量庞大、维度复杂,且多分散在各类平台(自有商城、第三方电商平台、行业资讯网站),手动复制录入不仅效率低下,还易出现误差,因此,数据抓取技术成为电商数据分析从业者的必备技能。

本文将聚焦电商数据分析场景,拆解主流数据抓取技术的原理、适用场景,结合实操案例说明技术落地方法,同时解读反爬应对策略与合规边界,帮助开发者高效、安全地搭建电商数据采集体系,为后续数据分析工作筑牢基础。

一、电商数据抓取的核心价值与应用场景

在探讨技术之前,先明确数据抓取在电商数据分析中的核心意义——它是连接“原始数据”与“有效分析”的桥梁,其价值主要体现在三个维度:

提升采集效率:替代人工重复性操作,将数据采集周期从“天级”压缩至“分钟级”甚至“秒级”,尤其适配618、双11等大促场景的实时数据监控需求,助力运营者快速响应市场变化。

保障数据质量:通过技术规则实现数据格式标准化,减少人工录入的遗漏、错录问题,为后续的销量分析、用户画像、竞品对比等工作提供高质量数据基础。

覆盖全场景需求:可同时采集内部业务数据(订单、用户、库存)与外部市场数据(竞品价格、行业趋势、用户评价),满足电商全链路数据分析需求,填补人工采集的场景空白。

具体到电商场景,数据抓取的核心应用包括:

竞品分析:抓取竞品商品价格、销量、评价、促销活动,分析竞品运营策略与市场竞争力;

商品监控:实时抓取自有商品与竞品商品的价格波动、库存状态,及时调整定价与补货策略;

用户洞察:抓取平台用户评论、评分、问答数据,提取用户需求痛点与满意度,优化产品与服务;

行业调研:抓取电商平台热销榜、品类排行榜、行业资讯,预判品类季节性需求与市场趋势。

二、电商数据抓取主流技术详解(附适用场景)

电商数据来源多样,不同数据类型(结构化/非结构化)、不同平台(静态/动态)需匹配不同的抓取技术。以下是四类核心技术的原理、优缺点及电商场景适配性,开发者可根据自身需求选型。

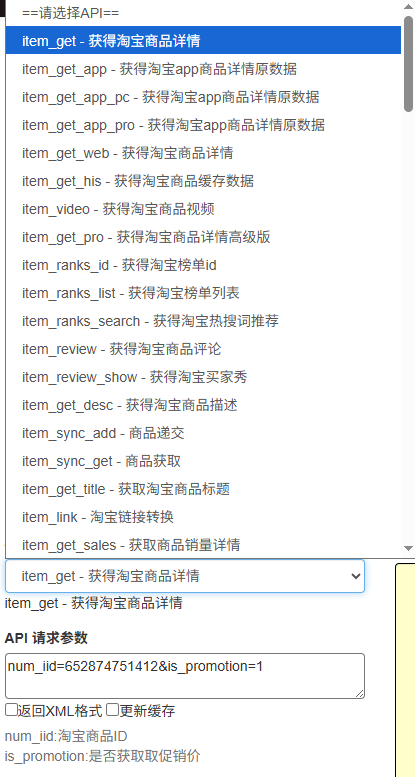

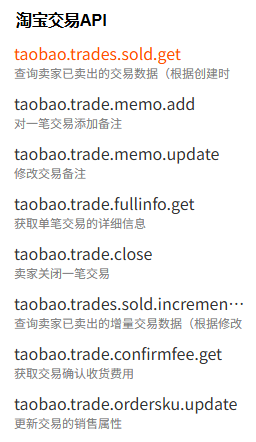

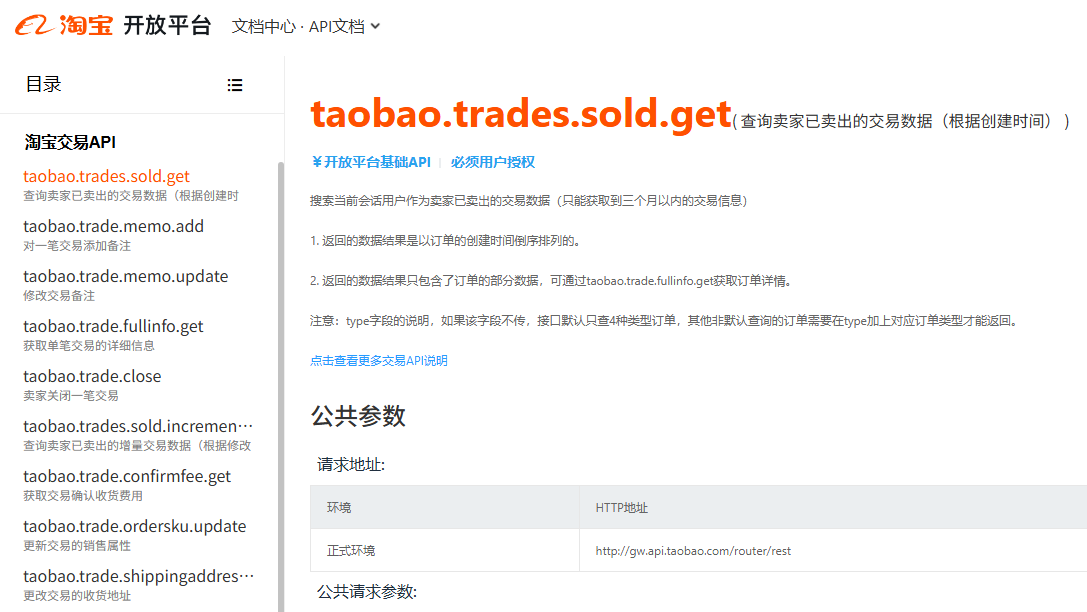

(一)API接口抓取:官方合规的核心方式

API(应用程序编程接口)是电商平台或第三方工具开放的数据交互通道,也是目前最合规、最稳定的抓取方式,适用于内部业务数据与官方授权的外部数据采集。

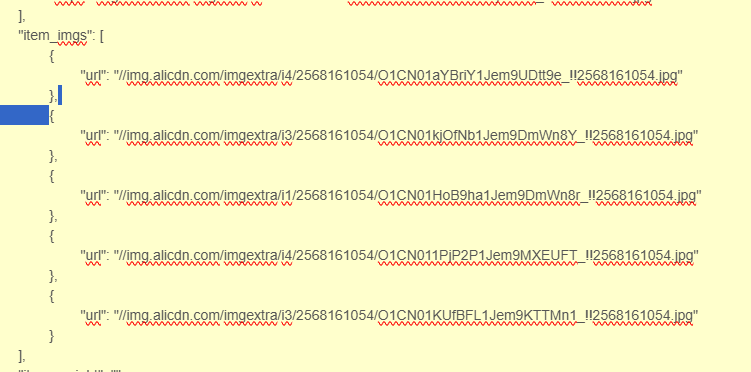

原理:平台(如淘宝开放平台、京东开放平台、抖音电商开放平台)通过API定义数据访问规则,开发者通过传入认证信息(如API Key、Token)与筛选参数,即可直接获取JSON、XML格式的结构化数据,无需解析网页源码,相当于“平台主动开放数据接口供开发者调用”。

核心优势:

合规性强:基于官方授权,完全符合平台规则与相关法律要求,避免IP封禁、法律追责等风险;

数据质量高:返回数据经平台清洗,字段定义清晰(如订单状态、用户等级、商品分类等均有统一标准),无需额外处理格式问题;

稳定性好:官方提供接口维护与技术支持,故障响应及时,适合核心业务数据(订单、支付、库存)的长期采集。

局限性:

调用限制:多数平台对API调用次数、频率有严格限制(如淘宝开放平台部分接口单日调用上限1000次),需根据业务需求申请更高权限;

数据范围受限:平台仅开放非敏感数据,竞品的详细销售数据、用户隐私数据(手机号、收货地址)等通常无法通过API获取。

电商适用场景:自有电商平台内部数据采集(如店铺订单、商品库存、用户会员数据);第三方工具对接(如ERP系统通过API同步平台订单,BI工具通过API拉取销售报表)。

(二)网络爬虫抓取:灵活适配外部公开数据

网络爬虫(简称“爬虫”)是通过代码模拟浏览器行为,自动抓取网页中公开数据的技术,适用于API无法覆盖的外部场景(如竞品分析、用户评价采集),也是电商数据抓取中最常用的技术之一。

原理:先确定目标网页(如竞品商品详情页、用户评论页、行业排行榜),通过爬虫框架发送HTTP请求获取网页HTML源码,再通过解析工具提取目标数据(如商品价格、销量、评论内容),最后将解析后的数据存储至数据库或文件。

电商场景中,爬虫主要分为两类:

静态爬虫:针对静态网页(HTML源码中直接包含目标数据,无需JavaScript渲染),代表工具与框架:Python的Requests库、BeautifulSoup、lxml,适合抓取简单的商品列表、静态资讯页面;

动态爬虫:针对动态渲染网页(目标数据通过JavaScript异步加载,HTML源码中无直接数据),代表工具与框架:Selenium、Playwright、Scrapy+Playwright,适合抓取淘宝、京东等主流电商平台的商品详情、用户评论、实时销量等数据。

其中,Scrapy+Playwright 是目前主流的动态抓取方案,它将Scrapy的高效爬虫架构与Playwright的动态页面处理能力结合,可无缝处理Ajax加载、模拟登录、表单提交等复杂场景,且无需牺牲Scrapy的性能优势,适配现代电商平台的Vue/React混合渲染架构。

核心优势:

灵活性高:可抓取任意公开网页数据,不受平台API限制,尤其适合竞品价格监控、用户评价分析等场景;

成本低:基于开源框架开发,无需申请平台授权,中小商家也能低成本实现数据采集;

可扩展性强:可通过配置代理池、多线程、分布式部署,提升抓取效率,适配大规模数据采集需求。

局限性与风险:

合规风险:若抓取未公开数据(如用户隐私信息)或违反平台反爬规则,可能面临IP封禁、法律追责;

维护成本高:电商平台常改版网页结构,爬虫解析规则需同步调整,否则会导致数据采集失败;

数据质量波动:网页中可能存在广告、异常值(如错误价格),需额外添加数据清洗逻辑。

电商适用场景:竞品数据采集(监控竞品价格变动、销量排名、促销活动);公开用户评价分析(抓取商品评论,提取关键词分析用户满意度);行业趋势调研(抓取热销榜,分析品类需求变化)。

(三)数据库同步:内部数据的实时流转方案

对于拥有自建电商网站、线下ERP系统的企业,数据库同步技术是实现“业务数据-分析系统”无缝衔接的关键,主要用于内部数据的抓取与同步。

原理:通过数据库同步工具(如MySQL的Binlog同步、Oracle的Data Guard、开源工具Debezium),实时捕获源数据库(如业务系统的订单库)的新增、修改、删除操作,自动同步至目标数据库(如数据分析用的数据仓库),实现数据的准实时更新。

核心优势:

实时性强:延迟通常低于1秒,适合大促期间订单实时监控、库存动态预警等场景;

数据一致性高:直接基于数据库日志同步,避免人工传输导致的数据丢失或不一致问题;

无侵入性:不影响业务系统正常运行,无需修改业务代码。

局限性:

技术门槛高:需熟悉数据库底层原理(如Binlog日志结构),且需保障同步过程不影响业务数据库性能;

仅限内部数据:仅适用于企业自有数据库之间的同步,无法获取外部平台(如淘宝、拼多多)数据。

电商适用场景:自建电商网站的订单、用户数据同步至数据仓库;线下门店ERP系统与线上电商平台的库存数据实时互通(如线下出库后,线上库存同步减少)。

(四)日志采集:用户行为数据的全量捕获

用户在电商平台的每一次操作(点击商品、加入购物车、浏览页面、放弃支付)都会生成日志文件,日志采集技术可实现这类“细粒度”用户行为数据的全量获取,为用户行为分析提供支撑。

原理:通过埋点工具(如百度统计、友盟、自研埋点SDK)在APP或网页中植入代码,记录用户行为(如“用户ID=123,操作=点击商品,时间=2026-04-12 10:30”);日志文件实时传输至采集系统(如Flume、Logstash),经清洗、结构化后,存储至大数据平台(如Hadoop、Spark),供后续分析使用。

核心优势:

数据维度细:可捕获用户“全链路行为”,不仅包括最终成交数据,还能还原用户从“浏览-加购-下单-支付”的完整路径;

无侵入性:埋点代码不影响业务系统运行,且可灵活调整埋点规则(如新增“分享商品”行为记录);

可扩展性强:支持海量日志数据采集,适配高并发电商场景。

局限性:

数据量大:用户行为日志通常以“TB级”每日增长,需配套大数据存储与计算资源,成本较高;

依赖埋点设计:若埋点规则不清晰(如未记录“放弃支付”的原因),会导致后续分析无法深入。

电商适用场景:用户行为分析(如分析“加购未下单”的流失原因,优化商品详情页);漏斗转化监控(如监控“首页点击-商品详情-加入购物车-下单”的各环节转化率);APP/网页体验优化(如统计页面加载时间、按钮点击频次,定位用户体验痛点)。

三、电商数据抓取实操案例(Python+Scrapy+Playwright)

结合电商最常见的“竞品商品数据抓取”场景,分享一个简单可落地的实操案例,实现抓取某电商平台商品的名称、价格、销量、评价数等核心数据,适合新手入门。

(一)环境准备

# 安装依赖包 pip install scrapy playwright scrapy-playwright # 安装Playwright浏览器引擎 playwright install

(二)项目搭建与核心代码

创建Scrapy项目:

scrapy startproject ecommerce_crawlercd ecommerce_crawlerscrapy genspider product_spider example.com配置settings.py(启用Playwright下载器):

# 启用Playwright下载器DOWNLOAD_HANDLERS = {"http": "scrapy_playwright.handler.ScrapyPlaywrightDownloadHandler","https": "scrapy_playwright.handler.ScrapyPlaywrightDownloadHandler",}# 配置Playwright浏览器PLAYWRIGHT_BROWSER_TYPE = "chromium" # 可选:chromium, firefox, webkitPLAYWRIGHT_LAUNCH_OPTIONS = {"headless": True, # 无头模式,生产环境启用"args": ["--no-sandbox"],}# 禁止robots协议(仅用于公开数据抓取,需遵守平台规则)ROBOTSTXT_OBEY = False# 配置下载延迟,避免高频请求触发反爬DOWNLOAD_DELAY = 2# 配置用户代理池(模拟真实浏览器)USER_AGENTS = ["Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/123.0.0.0 Safari/537.36","Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/123.0.0.0 Safari/537.36"]DOWNLOADER_MIDDLEWARES = {"ecommerce_crawler.middlewares.UserAgentMiddleware": 543,}编写爬虫代码(product_spider.py):

import scrapyfrom scrapy_playwright.page import PageCoroutinefrom ecommerce_crawler.items import EcommerceCrawlerItemclass ProductSpider(scrapy.Spider):name = "product_spider"# 目标商品列表页(示例,需替换为实际目标页面)start_urls = ["https://example.com/category/electronics"]def start_requests(self):for url in self.start_urls:# 使用Playwright请求,等待页面加载完成yield scrapy.Request(url,meta={"playwright": True,"playwright_include_page": True,"playwright_page_coroutines": [PageCoroutine("wait_for_selector", "div.product-item"), # 等待商品列表加载],},callback=self.parse)def parse(self, response):# 提取商品列表product_list = response.xpath("//div[@class='product-item']")for product in product_list:item = EcommerceCrawlerItem()# 提取商品信息(XPath需根据实际页面结构调整)item["product_name"] = product.xpath(".//h3/text()").get().strip()item["price"] = product.xpath(".//span[@class='price']/text()").get().strip()item["sales"] = product.xpath(".//span[@class='sales']/text()").get().strip()item["comment_count"] = product.xpath(".//span[@class='comment']/text()").get().strip()item["product_url"] = product.xpath(".//a/@href").get()yield item# 翻页(示例,需根据实际页面翻页逻辑调整)next_page = response.xpath("//a[@class='next-page']/@href").get()if next_page:yield scrapy.Request(next_page,meta={"playwright": True,"playwright_include_page": True,"playwright_page_coroutines": [PageCoroutine("wait_for_selector", "div.product-item"),],},callback=self.parse)定义Item(items.py):

import scrapyclass EcommerceCrawlerItem(scrapy.Item):# 商品名称product_name = scrapy.Field()# 商品价格price = scrapy.Field()# 销量sales = scrapy.Field()# 评论数comment_count = scrapy.Field()# 商品详情页链接product_url = scrapy.Field()

(三)运行与数据存储

1. 运行爬虫:scrapy crawl product_spider -o product_data.csv(将数据存储为CSV文件,便于后续分析);

2. 数据清洗:对抓取到的异常数据(如空值、错误价格)进行过滤,可使用Pandas处理;

3. 后续操作:将清洗后的数据导入MySQL、MongoDB等数据库,或直接用于Excel、BI工具分析。

注意:案例中的XPath、目标URL需根据实际电商平台页面结构调整,且需遵守平台反爬规则,避免高频请求。

四、电商反爬机制与应对策略

主流电商平台(淘宝、京东、拼多多)均有完善的反爬体系,核心目的是保护平台数据资产,防止恶意抓取导致服务器负载过高。了解反爬机制并掌握合理的应对策略,是数据抓取落地的关键。

(一)常见反爬机制

现代电商反爬体系已形成“多层纵深防御”架构,核心机制包括以下7类:

请求头验证:校验User-Agent、Accept、Referer等头部信息,甚至检测TLS指纹特征,拒绝异常请求;

IP地址限制:结合地理围栏、IP历史行为画像,拦截高频请求IP、爬虫IP段;

验证码机制:从静态图片验证码进化为行为式验证码(极验、腾讯防水墙),通过鼠标轨迹、设备特征识别人机;

Cookie与Session验证:要求完整复现登录态,Session与设备指纹强耦合,环境变更即触发二次验证;

动态渲染技术:核心数据通过JavaScript异步加载,返回数据经加密、混淆,需解析前端代码才能获取;

请求频率与行为检测:监测页面停留时长、点击轨迹等,识别模拟操作;

数据加密与接口逆向:API接口采用非对称加密签名、时间戳防重放,关键接口参数动态生成。

(二)合规应对策略

应对反爬的核心原则是“模拟真实用户行为,避免恶意抓取”,以下是开发者常用的合规应对方法:

优化请求配置:设置合理的下载延迟(1-3秒),使用用户代理池(模拟不同浏览器、设备),避免高频请求;

构建代理IP池:融合数据中心代理、住宅代理,建立IP健康度评估体系,避免单一IP被封禁;

处理动态渲染:使用Playwright、Selenium等工具模拟浏览器渲染,绕过JavaScript加密,避免直接爬取接口;

模拟真实行为:添加随机页面停留时长、鼠标滑动、点击等操作,避免机械性请求;

遵守robots协议:查看目标平台的robots.txt文件,不抓取禁止访问的目录与数据;

避免过度抓取:仅抓取所需数据,不批量抓取无关信息,减轻平台服务器负载。

警示:切勿使用恶意反爬手段(如破解加密接口、高频攻击服务器),否则可能面临IP封禁、账号注销,甚至法律追责。

五、电商数据抓取的合规边界(必看)

随着《网络安全法》《数据安全法》《个人信息保护法》的实施,数据抓取的合规性越来越重要,电商场景中需重点注意以下几点:

禁止抓取隐私数据:用户手机号、收货地址、身份证号等个人信息受法律保护,严禁抓取、存储、传播,即使是公开的用户评论,也需避免提取隐私信息;

尊重平台知识产权:电商平台的商品图片、文案、价格体系等属于平台或商家的知识产权,未经授权不得用于商业用途;

遵守平台规则:不得违反平台用户协议,不得恶意抓取导致平台服务器负载过高,否则平台有权追究法律责任;

数据用途合法:抓取的数据仅用于自身电商数据分析,不得用于刷单、恶意竞争、数据倒卖等违法违规行为;

留存审计日志:建立爬虫访问审计日志系统,留存请求/响应报文、操作记录,确保数据抓取全程可追溯。

六、总结与展望

数据抓取是电商数据分析的基础,选择合适的技术方案(API接口适合内部数据,爬虫适合外部数据,数据库同步适合自有系统,日志采集适合用户行为数据),既能提升数据采集效率,又能保障数据质量。

未来,电商数据抓取技术将呈现三大趋势:一是AI赋能反反爬,通过AI模拟更真实的用户行为,应对复杂反爬机制;二是低代码化,更多可视化抓取工具出现,降低非技术人员的使用门槛;三是合规化深化,数据抓取将更注重隐私保护与平台规则,形成“合规采集-高效分析-安全应用”的闭环。

对于电商从业者与开发者而言,掌握数据抓取技术的同时,需坚守合规底线,结合业务需求选型,才能让数据真正成为驱动电商业务增长的核心动力。

如果本文对你有帮助,欢迎点赞、收藏、评论,也可留言交流电商数据抓取中的实操问题~